A 50 anni dal primo segnale di internet, un supercomputer del Massachusetts Institute of Technology (Mit) riesce a controllare e analizzare l'intero traffico sulla rete che passa in un giorno. Potrebbe aiutare a migliorare la sicurezza sul web, individuando subito gli attacchi, e progettare infrastrutture informatiche più efficienti. La ricerca, coordinata da Jeremy Kepner, del Mit, è stato presentato alla conferenza Ieee ad alte prestazioni per il calcolo estremo.

"Una grande sfida nella sicurezza informatica è comprendere le tendenze su scala globale del traffico Internet, al fine di individuare attacchi e creare difese contro i virus informatici. Questo gruppo di ricerca ha affrontato con successo il problema, presentando un'analisi approfondita del traffico di rete globale", ha osservato l'informatico David Bader, del New Jersey Institute of Technology.

Per individuare le minacce informatiche, e quindi le anomalie nel traffico sulla rete, è infatti importante conoscere la dinamica del traffico normale. Tuttavia le tecnologie attuali possono analizzare solo piccoli campioni di pacchetti di dati, scambiati tra fonti e destinazioni vicine. I ricercatori hanno superato questa limitazione in collaborazione con il progetto Wide (Widely Integrated Distributed Environment), fondato da diverse università giapponesi, e con il Center for Applied Internet Data Analysis (Caida), in California.

La collaborazione ha acquisito il più grande set di dati al mondo sul traffico Internet, che contiene 50 miliardi di pacchetti di dati scambiati in diverse località in tutto il mondo per un periodo di alcuni anni, compresi dati relativi a Facebook e Google.

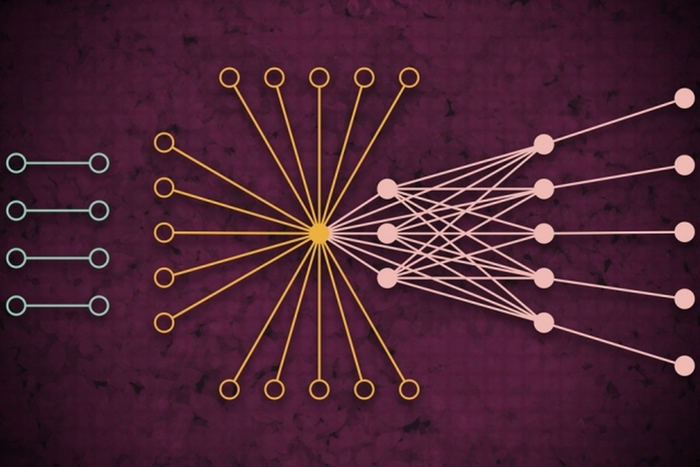

I ricercatori sono riusciti ad analizzare questo traffico di dati spacchettando questi ultimi in unità più piccole, di circa 100.000 pacchetti, elaborati da reti neurali artificiali, ossia da reti che imitano le connessioni delle cellule nervose. Grazie ai 10.000 processori del supercomputer del Mit è stato ottenuto automaticamente un modello che acquisisce la relazione per tutti gli attori dello scambio di dati, dagli utenti comuni ai giganti come Google e Facebook, fino ai collegamenti rari e sporadici che hanno comunque un impatto sul traffico web.

Caricamento commenti

Commenta la notizia